算力繁荣,正在从GPU全面扩散到内存、硬盘、CPU

本文来自微信公众号: 未尽研究 ,作者:未尽研究

谷歌、微软、亚马逊与Meta,同日发布财报,几乎同步上修了资本开支预期。它们证明AI在吃掉世界的同时,正在以前所未有的速度吞噬全球算力产能,并开始从GPU,扩散到内存、硬盘,甚至CPU。

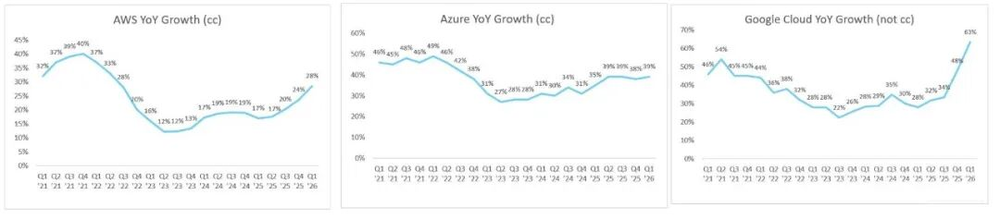

云收入是AI吃掉世界的关键证明之一。由于OpenAI星门建设缓慢,Anthropic也不自建算力,全球大多数的token生产与消耗,都集中于这些科技巨头的AI基础设施中。当季,谷歌云季度收入200亿美元,增速63%,较上一季度提高15个百分点;微软云收入545亿美元,其中Azure同比增长超40%;亚马逊AWS收入约376亿美元,增速28%,15个季度以来最快。

尽管这些巨头仍然将AI业务的真实收入,隐藏在庞大的传统业务之中,尤其是广告这一现金牛之后,但高频使用指标已提供了更具穿透力的观察视角。谷歌第一方模型API每分钟消耗160亿token,环比增长60%;亚马逊一季度消耗token超过此前所有年份总和的10倍。

值得关注的是,微软再次公布了“AI业务”的ARR(经常性年化收入)指标,截至当季,超过370亿美元,似乎要显示超过Anthropic 300亿美元。不过,这一指标的外延,至今并不清晰。去年初,微软曾披露过ARR约为130亿美元,但此后一年里,微软再次将AI收入重新埋回各业务线。

所有巨头都说,自己还能赚得更多,只是物理世界的产能,限制了AI世界的扩张。当季,谷歌订单积压超过4600亿美元,几乎环比翻倍;微软订单积压为6270亿美元,同比接近翻倍;亚马逊订单积压3640亿美元,这还没来得及算上与Anthropic的1000亿美元长期协议。

于是,高管向市场释放进一步增加资本开支的预期。这四家巨头在2026财年的资本开支合计最高达7250亿美元(亚马逊2000亿、微软1900亿、谷歌1900亿、Meta 1450亿)。

谷歌的资本开支,在4年间增长了近6倍,高管预期2027年资本开支会显著高于2026年,这是“维持AI竞争所必需的残酷创新节奏”。Meta将2026财年的资本开支的上下限,都上调了100亿美元,因为此前“低估了计算需求”。亚马逊甚至因为大幅增加资本开支,自由现金流从去年同期的259亿美元,骤降至12亿美元,这样的挑战还会持续几年。

但是,与以往不一样的是,这次,高管们都在强调英伟达以外的硬件。它们包括公司自研的AI芯片与CPU,也包括对外采购的内存、硬盘与CPU。面向AI基础设施的资本开支,已经真正从GPU采购,转向了整个“AI工厂”的资产负债表。

回顾ChatGPT发布至今,初入AI时代,市场首先看到的是扩展定律支配下,越来越庞大的参数规模与预训练数据集,支撑着庞大的训练算力需求;随后,o1发布,市场预期在“杰文斯悖论”生效下,AI推理继续吞噬浮点计算的能力。当这一切真正到来后,市场很快意识到,在高效、持续、低成本地生成token的过程中,数据移动成为新的瓶颈。于是,资本开支向存储与网络迁移。如今,在智能体时代,作为系统调度与工具调用关键瓶颈的CPU,迎来了自己的复兴。

这些趋势推动2026年进入“内存超级周期”

2025/10/27完整阅读>

ARM的AI叙事:AGI路径与CPU复兴

2026/03/26完整阅读>

内存已经开始接管数据中心的资本支出。据分析机构semianalysis统计,在短短四年内,这一数字增长了近4倍。在回复分析师的提问时,几家科技巨头的高管,几乎都提到了内存等组件的涨价;即使不买更多的GPU,也将推高几家巨头的资本支出。微软最直接,首席财务官提到在2026财年全部资本开支的1900亿美元中,其中包含250亿美元来自存储芯片等组件价格上涨的冲击。

内存短缺可能持续到2030年。全球内存三大巨头都在积极扩产,但是,即使到明年年底,产能也仅够满足60%的需求。越来越多的DDR5,都被拿去堆叠成了HBM。即便DDR5本身,也在AI推理的预填充阶段找到了新场景。TrendForce预计,在今年第二季度,DRAM合同价格将上涨58%至63%,NAND合同价格将上涨70%至75%。凭借着NAND需求的增长,及其处于中试产线落地中的HBF概念,闪迪年初至今市值已经增长了350%。

HBF竞争开启,“HBM之父”怎么看|笔记

2026/04/15完整阅读>

AI的内存饥渴,甚至开始加热传统“冷数据”储存的硬盘市场。本周,希捷财报公布,宣布近线HDD成为数据中心的稀缺货,2027年产能几乎卖光。它的逻辑是,智能体持续自动运行的工作流,以及物理AI合规要求(一辆自动驾驶汽车每小时4TB数据),共同推高了长期存储需求。

英特尔CEO陈立武,在最近一次财报会议上,大谈CPU已经成为整个AI技术栈编排层和关键控制面,“过去CPU和GPU的配比通常是1:8,而现在是1:1左右”。ARM公司则认为,智能体时代每GW数据中心对CPU的需求将增长4倍。

而CPU数量的增加,也将进一步推升对低能耗内存的需求。与英伟达Rubin GPU相搭配的是Vera CPU,英伟达向内存厂商下达了新型内存SOCAMM的标准与订单,后者是由LPDDR DRAM构建的;相比上一代CPU,Vera的最大容量增加了两倍,配有8个SOCAMM模块。年初,高通与AMD就选择跟进。

英伟达并没有被忘记。在其他四家科技巨头的财报会议上,它日益充当礼节性客套话的背景。高管们开始长篇累牍地宣称自家定制芯片。进展慢些的,强调它节省了资本开支与运营开支;而进展迅速的,已经开始畅想将这些芯片以硬件销售的形式商业化。

谷歌表态称,随着AI实验室对TPU需求的增长,公司将开始向精选客户在其自有数据中心中以硬件配置的方式交付TPU,以扩大可寻址市场机会,并预计今年晚些时候将开始确认部分收入,绝大多数收入将在2027年实现。

亚马逊则称,如果它的芯片业务独立,那么当前ARR将达到500亿美元,且形成超过2250亿美元的营收承诺;该公司的自研CPU Graviton已经进入Meta视野,因为它比任何其他x86架构,性价比要高出40%;亚马逊预计,再过几年,可能会以整机架(racks)的方式,商品化自己的芯片业务。

而Meta则提到正在部署超过1GW的自研芯片。微软也大谈自家Maia 200与Cobalt CPU的性价比。

黄仁勋的“五层蛋糕理论”,包括能源、芯片、基础设施、模型与应用。在这一分层结构中,价值的释放路径,整体也呈现出清晰的扩散特征。

以英伟达为首的芯片环节,是最开始挣钱的,如今资金向内存、网络与CPU厂商分流;以云厂商为代表的基础设施,其收入增长也随之加速;年初,以Anthropic为典型的模型厂商,ARR几个月内就数倍增长,初步验证了自己的价值捕获能力。

但下一阶段的关键变量,仍然取决于应用层——尤其是那些脱离巨头全栈体系、无法被内部补贴所掩护的应用——能否兑现真实的财务回报。

市场的疑问在于,那些tokenmaxxing的军备竞赛,是否能够在支出成倍增长的同时,带来等比例的收入扩张。只有当这一闭环被验证,投资者面对当前已占标普500近45%市值的AI资产时,才不至于在乐观与不安之间反复摇摆。

否则,“这次不一样”仍然只是一句被反复讲述、却尚未被现金流验证的叙事。

#算力繁荣正在从GPU全面扩散到内存硬盘CPU